蒸馏全网 Image2 Prompt:开源 yinyo-image2-prompt Skill

把全网能找到的 Image2 Prompt 经验蒸馏成一个可执行的 Skill,覆盖 35 个子模板、8 大场景,经 33 组交叉盲评验证。

最近因为产品设计,总是习惯性先让 GPT-Image-2 生成效果图找找灵感。不过 Image2 生成的图片质量参差不齐,很多时候构图和光线都很普通。

GPT-Image-2 本身能力很强,网上各种酷炫案例层出不穷,但同样的 API 调过去,出来的图却平平无奇。

答案很直接:Prompt 不行。

找 Prompt 的困境

满屏都在展示 GPT-Image-2 的神图,但打开一看,只有图,没有 Prompt。

GitHub 上有大佬整理的 awesome 列表,370 多个案例,图片确实惊艳,但大部分是社区成品展示,没有结构化的 Prompt 可以复用。想学?自己逆向拆去。

OpenAI 官方倒是出了个 Cookbook,讲了几条原则,但原则和「我现在马上要出一张产品图」之间,差了十万八千里。

自己做一个 Prompt 引擎

思路很简单:把全网能找到的 Prompt 经验——OpenAI 官方 Cookbook、GitHub 社区案例、工业级模板库——全部蒸馏一遍,变成一个直接能用的东西。

目标不是又一个 awesome 列表,而是一个 AI 读了就能用的执行引擎。识别场景、引导参数、输出 Prompt。不需要你会写 prompt,也不需要懂专业知识。生成写实人像,不需要知道 Kodak Vision3 500T 胶片质感、80mm 镜头这些概念,只需要描述基本诉求,Agent 通过交互引导,逐步挖掘你的想法和目的,生成对应质感的 Prompt。

为了验证有效性,用 Codex + GA 跑了 33 组交叉盲评,共 66 张图,和 GitHub 上 500+ 案例的顶级 Prompt 库正面 PK,整体效果不错。

下面直接看图,全部由 Skill 模板生成的 Prompt 调用 GPT-Image-2 产出,零后期。

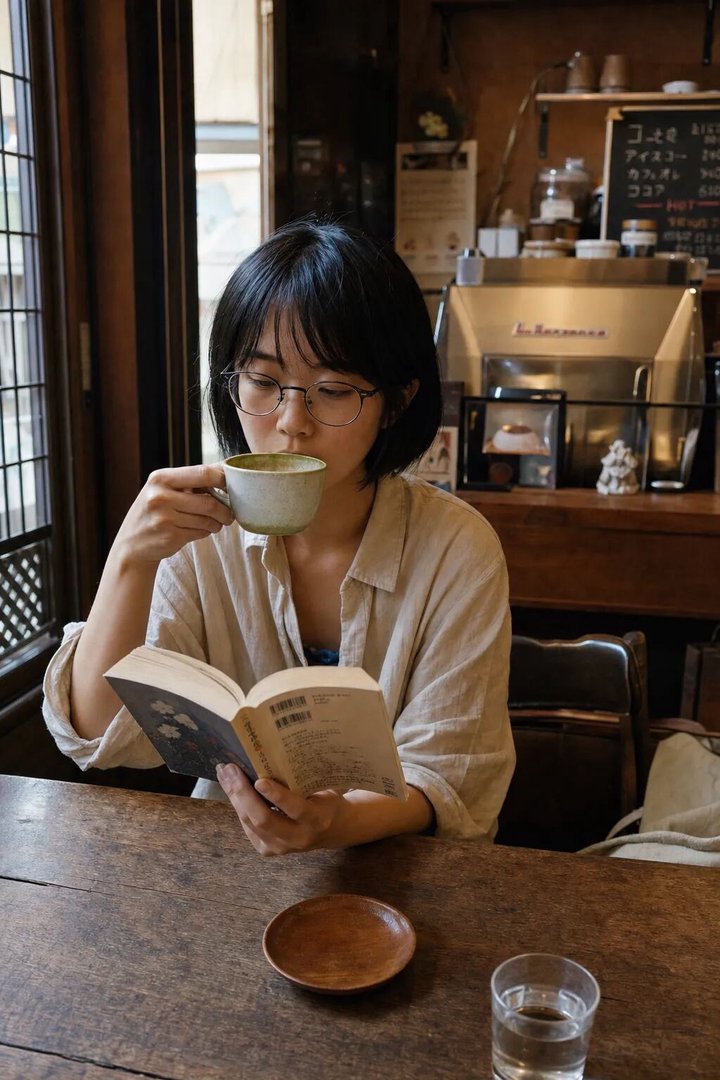

写实摄影

模板 A1,场景人像。35mm 胶片质感,50mm 镜头,窗光 4500K 色温,真实皮肤纹理。

电影质感

模板 C,Film Noir 子风格。Kodak Vision3 500T 胶片模拟,高对比黑白,百叶窗阴影,变形宽银幕。

App UI

模板 E,盲评中大胜网上众多 Prompt 的场景。UI 这种东西,结构化描述越精准,生成的效果越好。

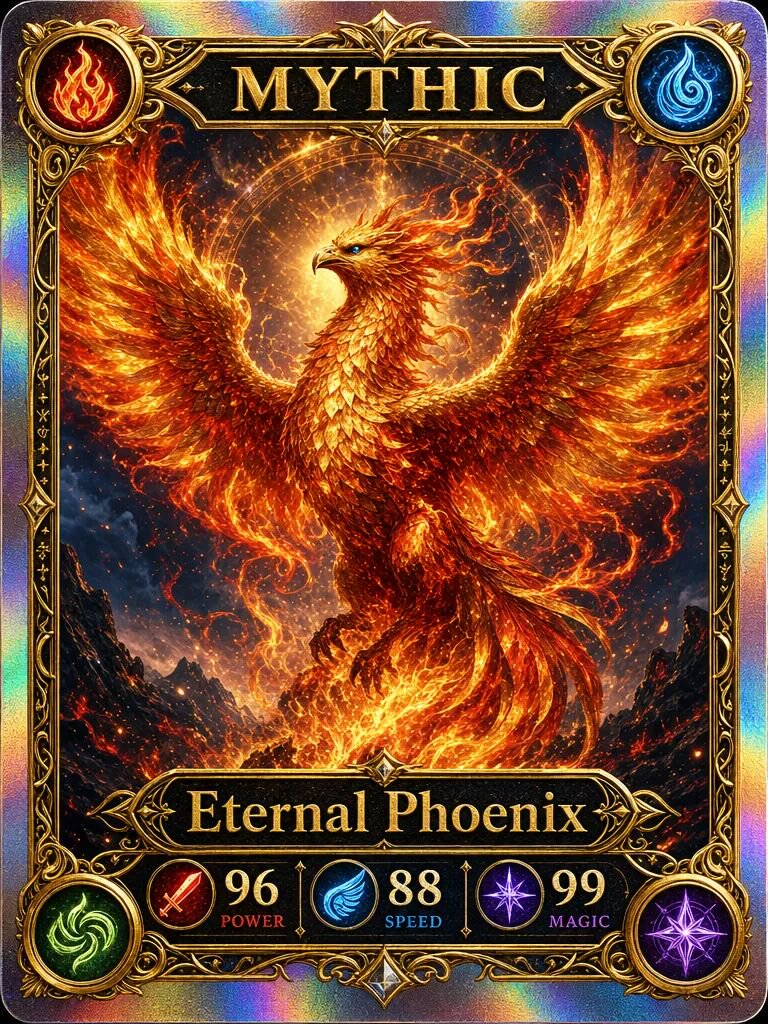

交易卡

模板 I1,全息凤凰。灵感来源于工业级模板的思路,做了重构。

它不只是模板库

上面几个场景,覆盖的只是 35 个子模板里的一部分。写实摄影 5 个、电影质感 6 种子风格、创意概念 10 个、编辑工作流 10 种——风格迁移、虚拟试穿、产品提取、图片翻译,都有。

但最重要的不是数量,是它知道什么时候不该用模板。

在回归测试中发现,有些场景你越认真写结构化 Prompt,出来的图反而越差。创意驱动的场景需要留白,不是所有地方都该填满参数。

所以它有一套 5 步引导流程——先判断复杂度,再确认场景,然后按场景引导参数,输出 Prompt 让你确认,生成后还能循环反馈。

开源信息

MIT 协议,直接扔给你的 Agent:

GitHub:xiaoshiyilangzhao1996-droid/yinyo-image2-prompt

同一个模型,同一个 API,Prompt 不同,出来的图完全是两个世界。

原文:隐曜yinyo杂货铺

加载评论中...